#discuz会产生哪些无效的页面,有什么问题?

1.删除了的帖子、版块,当访问时返回帖子不存在的提示信息页。

2.设置了一定权限才能浏览的帖子、版块,得到没权限的提示。

3.其它各种情况下的提示信息页面。这些都是给用户看的,没有实质内容。

以上这些页面的URL仍是正常的URL,但内容只是给用户看的,没必要SE收录。产生最大的问题还是重复内容的问题,如无权限访问的帖子,大量删除的帖子,不同的URL有很多,但内容都是一样的,这些重复页面没有什么用,对SE不友好。(其实对于删除了内容,应该返回404,但为了简单,都使用加meta robots标签,禁止ES收录的方法来解决)

#修改提示信息页面,加入meta robots禁止收录,解决重复内容问题。

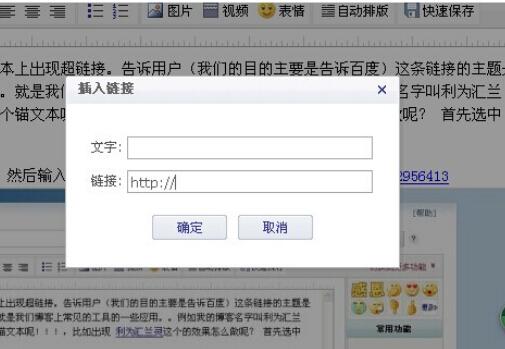

修改global.func.php文件中的showmessage函数,在这个函数中 define('CACHE_FORBIDDEN', TRUE); 这一行的后面加上$extrahead .=''; 。

至此,dz所有提示页面,都有meta robots标签声明禁止收录,SE就不会收录无权访问的URL、对于已删除的帖子,因为禁止收录了,过一段时间也会从索引中删除。这样,给SE的都是一些有内容的网页,对于提高权重会有好处。

作者:SEO小工; 出处: ;版权所有,转载请保留本声明并注明作者、出处、和原文链接

申请创业报道,分享创业好点子。点击此处,共同探讨创业新机遇!