Check Point收购Lakera,GenAI 防护体系全面升级

最近一两年,生成式 AI 正迅速成为企业业务发展的新引擎。从内容生成、客户支持到自动分析与辅助决策,越来越多的企业将大型语言模型(LLM)与 GenAI 应用嵌入核心流程。然而,当企业加速推动智能化时,一个愈发突出的现实问题正在出现:AI 的创新速度远远超过了安全体系的准备程度。

提示注入(Prompt Injection)、越狱攻击、敏感数据泄露、有害内容生成、滥用行为操控……这些风险都不基于传统漏洞,而是基于“语言”本身。攻击者无需编写脚本,也无需针对服务端寻找漏洞,只需一段语义误导性提示语,便可能突破既有安全机制。传统 Web 安全体系根本无法理解这些语言型攻击的逻辑,更不具备识别能力。这些挑战正是Check Point收购业内领先的AI安全公司Lakera ,并推出 CloudGuard WAF GenAI 安全扩展方案的初衷。

GenAI 时代安全问题挑战

传统安全体系擅长处理代码层面的漏洞:SQL 注入、XSS、RCE、越权访问、API 滥用……而生成式 AI 面临的风险类型却截然不同:

·攻击者可以通过语言操控模型行为

·模型可能在毫无意识的情况下生成敏感内容

·智能体可能在外部误导下执行超出授权范围的动作

·对话语境本身可以成为攻击载体

这类问题的本质不在模型内部,而在于交互逻辑、提示语内容及其语义关系。这也意味着:GenAI 的安全问题不是“修漏洞”,而是“理解语言与意图”。

Lakera 作为领先的AI安全厂商,长期专注于提示注入检测、越狱识别、语义滥用行为分析,并构建了大量真实攻击样本与提示语语料库。因此其技术天然适配这一新场景,也是后来被 Check Point 收购并纳入平台的关键原因。

CloudGuard WAF + Lakera:双层机器学习架构,面向 GenAI 的新安全模型

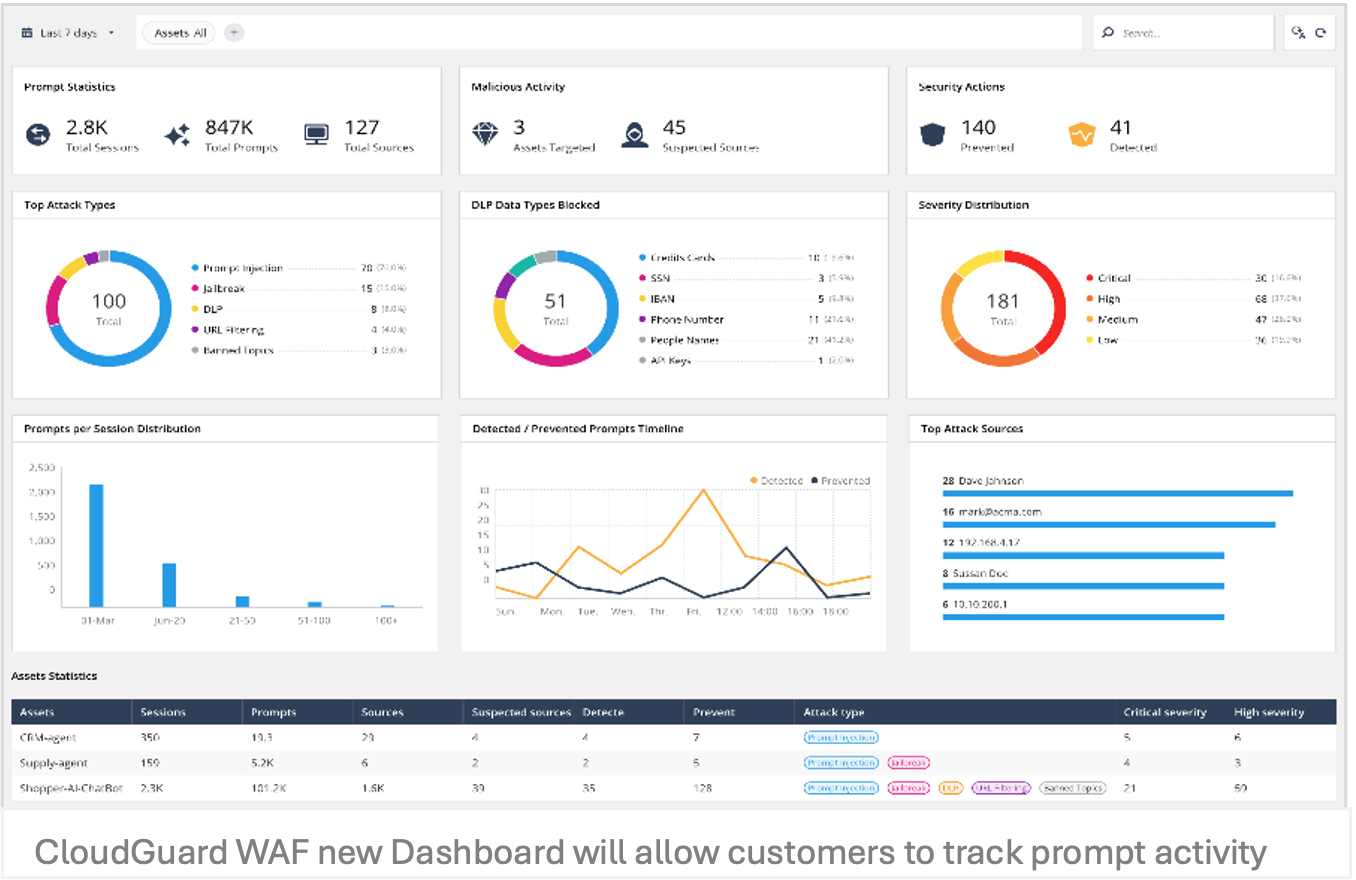

Check Point 最新发布的 CloudGuard WAF GenAI 安全扩展方案,是整合 Lakera 技术后的重要落地成果。新架构由两层机器学习模型(Dual-Layer ML Security)构成,专门用于理解语言风险、识别语义攻击,并对模型交互提供实时防护。

第一层:Lakera 强化的监督式机器学习(处理 90%+ GenAI 流量)

这一层基于大量攻击提示语与良性提示语训练,专门识别语言型威胁。主要包括四类能力:

·Prompt Injection 防护:识别越狱、操控性指令、暗示性语境

·数据泄露防护:避免模型输出中泄露敏感或机密信息

·内容控制:过滤违反企业政策、不安全或不合规的 LLM 输出

·使用/滥用控制:识别异常行为、滥用模式与资源消耗异常

Lakera 的加入,为这一层提供了更强的语言基础与攻击分析能力。

第二层:无监督 机器学习(随应用实时学习)

第二层更关注“模型在用户业务场景下如何被使用”,通过实时学习与语义分析来降低误报并增强适配性。包含:

·用户行为模式分析

·群体行为基线

·可信输入白名单

·语义精炼引擎(专利申请中)

这一层的价值在于使安全解决方案能理解业务语境,知道哪些提示语是自然合法的,哪些是不应出现的异常语义。

CloudGuard WAF 与 Lakera 的深度整合,能够在超过一百种语言环境中理解语义结构与潜在风险,真正实现跨语言、跨场景的威胁识别。同时,双层机器学习架构显著降低了误报率,使防护结果既精准又稳定,不会对业务团队造成额外负担。

更重要的是,这套体系几乎不需要管理员投入额外调优即可部署,企业在上线 GenAI 应用的第一天就能够获得可用的防护能力。无论是模型驱动的应用、与 LLM 交互的 API,还是正在兴起的AI Agents,都能够开箱即用地接入这套防护体系。这让企业在推动 AI 创新的同时,不必再为基础安全能力的缺失而放慢节奏。

AI 安全的未来:从修漏洞到理解语言风险

随着生成式 AI 在企业中的渗透加深,安全的关注重心正在从“补丁、漏洞、权限”转向“语义、意图、行为”。AI 安全未来的核心不是“围堵”,而是主动理解提示语的目的、理解模型的语境、理解交互背后的攻击意图。

越来越多企业将 AI 嵌入业务流程,意味着安全体系必须随着对话而演进。威胁情报等一些列动作,积极的为用户打造一套保障未来的安全体系。Check Point CloudGuard WAF 与 Lakera 的有机结合旨在为用户交付一个能学习、能适应、能理解语义的AI安全系统,而不是传统规则安全引擎的延伸。

申请创业报道,分享创业好点子。点击此处,共同探讨创业新机遇!