ChatGPT掀起的新一轮人工智能狂欢下,隐藏在背后的“大模型”正进入越来越多开发者的视野。

诚如几年前开始流行的一种说法:数据是燃料、模型是引擎、算力是加速器。ChatGPT的出现,恰如其分地诠释了数据、模型和算力的“化学反应”。而在其中扮演“桥梁”角色的,恰恰是上承应用、下接芯片的AI框架。

正是在这样的背景下,市场调研机构Omdia通过对AI开发者进行调研,在日前发布了《中国人工智能框架市场调研报告》,向外界揭示了国内开发者对于AI框架的认知,以及不断变化的行业格局。

01 开发者眼中的AI框架市场

随着ChatGPT的热度越来越高,不少人坦言:“人工智能领域正在引发新一轮科技竞赛”,其实AI的学术竞赛在2020年前后就已经开始。

OpenAI在这一年推出了著名的GPT-3,拥有1750亿参数量;DeepMind的AlphaFold2在第14届国际蛋白质结构预测竞赛中夺冠;同时全球AI论文发表量逐年增长,来自中国的论文比例越来越高...... 顶会论文、大模型、科学智能代表的技术生态,达到了前所未有的热度。

同样是在2020年,以昇思MindSpore等为代表的中国AI框架纷纷开源,开始了追赶TensorFlow、PyTorch等前辈们的追逐赛,中国AI框架的崛起和技术生态的繁荣,不可避免地出现了交叉。

就像Omdia在《中国人工智能框架市场调研报告》中给出的观点:在大模型应用的趋势下,国内开发者对于AI框架的认知发生了一些微妙的变化。

比如“对于超大规模模型训练能力,您觉得哪个人工智能框架最好?”的问题中,36%的开发者投票给了TensorFlow/JAX,15%的开发者选择的是PyTorch,昇思MindSpore以10%的占比排名第三。

需要说明的是,开发者的答案在某种程度上受到了认知习惯的影响,自然而然地给“老牌框架”打了高分。譬如谷歌的TensorFlow并非原生支持大模型,通过新推出的另一个新生框架JAX作为TensorFlow的简化库融入;PyTorch则是靠第三方并行算法库补充了大模型支持能力。昇思MindSpore正依托原生支持大模型的能力快速崛起。

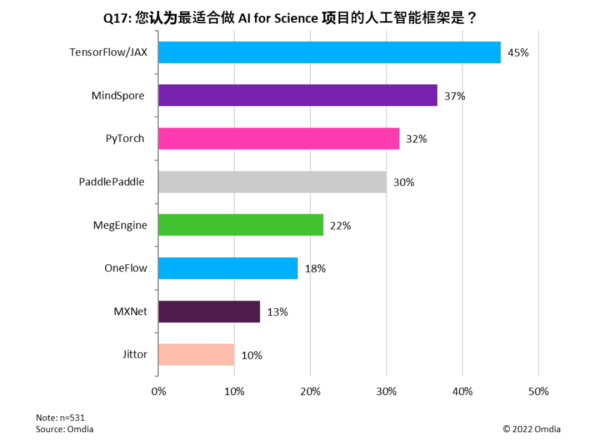

再比如“您认为最适合做AI for Science项目的人工智能框架是?”的问答下,TensorFlow和新生框架JAX收到了45%的开发者支持,昇思MindSpore在这个问题下超过了PyTorch,以37%的支持率排名第二。

而在人工智能框架使用率的排名中,TensorFlow和PyTorch的先发优势依然存在,但昇思MindSpore以11%的份额进入第一梯队。TensorFlow早在2015年就已经开源,PyTorch的历史也可以追溯到2017年,昇思MindSpore比“前辈”们晚了三到五年,但表现出了快速赶超老牌AI框架的态势,扮演了“挑战者”的角色。

如果说Omdia的报告主要是基于开发者的认知,可能与实际情况存在一定出入,那硬核的技术生态与行业生态的合作,则以板上钉钉的数字佐证着昇思MindSpore等中国AI框架崛起态势:

在技术生态方面,昇思MindSpore已经与200多所高校、科研机构展开创新合作;在行业生态方面,仅在2022年获得昇思技术认证的企业就超过800多家,涵盖制造、金融、电信运营商等国计民生行业;在开源生态方面,昇思MindSpore在Gitee AI开源项目综合排名TOP1,软件下载增速第一,总量已超过370万……

02 昇思MindSpore越级的时与势

一个残酷但有现实意义的现象是,2020年AI框架市场还是一幅百家争鸣的景象,目前却出现了典型的虹吸效应。

按照Omdia的调研数据,在中国人工智能框架的使用率方面,TensorFlow、PyTorch、昇思MindSpore和飞桨合计占了86%的市场份额,大多数AI框架的使用率不足1%,曾经声名鹊起的Caffe、CNTK等已逐渐掉出主流队伍,只有昇思MindSpore一家逆势进入了AI框架的第一梯队。

想要弄清问题的答案,昇思MindSpore可以说是最好的研究对象。过去近三年时间里,昇思MindSpore到底做对了什么?

第一个参考答案是大模型的“时”。

2021年9月的华为全联接大会上,昇思MindSpore迭代至1.5版本,最直接的变化就是原生支持AI大模型训练,通过全自动并行、可视化智能调优等大幅提升了大模型的开发效率。

其中在大模型并行训练上,昇思MindSpore支持数据并行、MoE并行、优化器并行、多副本并行等7大并行计算能力,将训练千亿模型的代码量降低了80%、调优时间下降60%;和TensorFlow、PyTorch等框架相比,昇思MindSpore是支持模型结构最全的AI框架,包含稠密、稀疏MoE、卷积结构、高维稀疏等。

第二个参考答案是应用创新的“势”。

2022年11月发布的2.0版本中完成了AI与HPC的融合,通过神经网络模拟的非线性拟合,让科学家无需再解高维方程,进一步提升了科技创新效率。特别是在产业应用创新方面,昇思MindSpore构建了流体仿真、电磁仿真、分子模拟在内的科学计算套件,持续使能应用创新。

和PyTorch的兴起不谋而合,昇思MindSpore也将技术生态作为“先手棋”。印证昇思MindSpore “路线正确”的案例,绝不止Omdia的报告和开发者的认同,还有一份沉甸甸的成绩单。

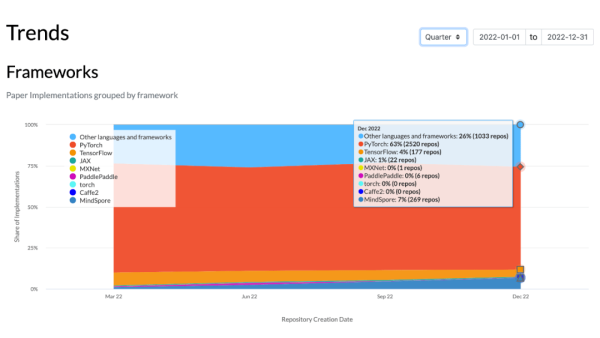

衡量创新能力的一个重要标准正是论文数量。按照Papers with Code网站的统计数据,2022年使用昇思MindSpore的顶级会议论文已经超过600篇,在国内AI框架中排名第一,在全球范围内仅次于PyTorch。

而在大模型的创新中,目前国内科研院所和高校已经发布了10多个基于昇思MindSpore的大模型。其中紫东.太初是全球首个三模态大模型,能够实现视觉、文本、语音三个模态间的高效协同,曾在2022世界人工智能大会上斩获“卓越人工智能引领者”奖;东方.御风是业界首个工业级流体仿真大模型,在进行飞机流场模拟仿真时,对比传统的科学计算,在精度一样的情况下,东方.御风的仿真时间只需要原来的1/25。

如果把人工智能产业生态比喻成森林的话,人工智能框架就像是森林中的土壤,寻求创新的开发者自然会“择水土而居”。

03 不应被忽视的可信AI问题

在全民“调戏”ChatGPT的风潮中,ChatGPT有时会“一本正经地胡说八道”,这其实暴露了存在事实性错误、知识盲区和常识偏差等诸多问题。

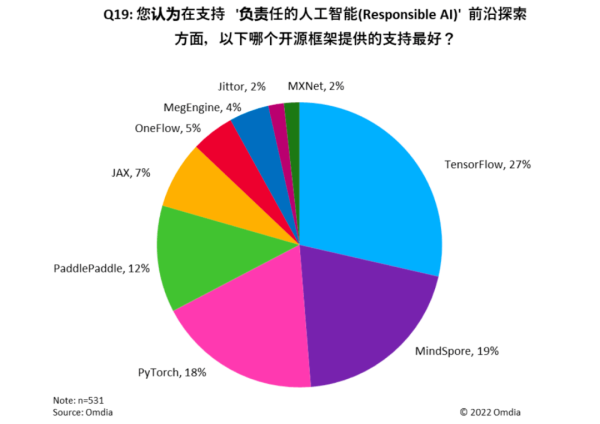

Omdia在《中国人工智能框架市场调研报告》中向开发者询问了类似的问题,最终的答案似乎超出了一些人的料想:在所有主流人工智能框架中,国内的开发者普遍认为TensorFlow 与 昇思MindSpore 对“负责任的人工智能”提供的支持最好。

个中原因其实不难解释。为了打消开发者担心的安全隐私等问题,谷歌通过Model Cards等工具让框架更加透明、更具备可解释性,同时TensorFlow也提供了一系列支持数据安全和隐私的功能、库和培训工具。

昇思MindSpore之所以能够在可信方面超越PyTorch,离不开对AI安全技术体系的布局,提供了涵盖AI训练、AI测评、AI部署的一整套端到端的安全可信体系,包括联邦学习、模型水印、模型加密等外界所熟知的可信机制。

比如联邦学习是一种常见的隐私保护方式,可以在不收集数据的情况下协同进行模型的训练,实现数据的“可用不可见”,继而保护隐私信息。然而联邦学习和大模型的结合也产生了诸多挑战,涉及到计算代价、通信开销、隐私泄露、模型安全等等,需要解决隐私保护与效率的两难课题。

昇思MindSpore的回答是跨域可信训练。

以鹏城.盘古大模型为例,昇思的联邦学习能力助力盘古超大模型协同训练,根据各地算力情况将大模型拆分,以AI计算中心超大算力实现盘古主干网络的正反向训练,同步在银行等计算机房做数据处理,模型Embedding、TOP层算Loss正反向训练,实现了敏感数据不出本地,并让联邦学习的训练时延降低了30%、通信和计算开销降低了40%。

就像Omdia在报告中的评论:“负责任的人工智能”即是一套道德准则,又是一套技术体系, 是以安全、可靠和合乎道德的方式开发、评估、部署和规模化人工智能系统的方法,对人工智能的可持续发展非常重要。

大模型、科学智能等技术生态在过去三年时间里深入影响了开发者对AI框架的选择,把时间再拉长一些的话,能否在可信AI方面有所作为,能否打消开发者的疑虑,无疑将左右AI框架下一个三到五年的市场排位。

04 写在最后

人工智能的星星之火能否燎原,AI框架有着不可或缺的作用。

一座城市的繁荣,不在于有多高的摩天大楼,而是无处不在的建筑群。沿循这样的逻辑,AI框架的价值在于赋予不同的开发者“建造高楼”的能力,让人工智能的前沿能力进入每一个行业、每一家企业。

至少,以昇腾AI为首的中国人工智能产业建设者早已开始发力。

不只是昇思MindSpore在技术生态上的异军突起,Atlas系列硬件、异构计算架构CANN、昇腾应用使能MindX等软硬件也在持续创新,为开发者打造了“端、边、云”的全场景AI基础设施,让人工智能在千行百业不断扩散。

申请创业报道,分享创业好点子。点击此处,共同探讨创业新机遇!

2025年10月25日,2025世界青年科学家峰会之人工智能(AI)融合创新发展论坛在浙江温州成功举办。本次论坛由国际院士科创中心主办,中国投资协会能源投资专业委员会、温港院士科创中心承办,中国电工技术学会、中科先进技术温州研究院与温州市电力工程学会提供支持,以“瓯江论道-AI赋能绿色发展”为主题,

个人创业需要启动成本低、无需庞大团队、可快速验证、能利用个人技能或资源。这里分享适合个人创业的十个机会一.AI内容优化与本地化服务·做什么:帮助企业或个人利用AI工具(如GPT-4,Midjourney)优化内容生产流程。例如,为跨境电商撰写多语言产品描述,为小红书博主生成爆款文案,为小公司制作营销

百度AI团队今日正式推出PaddleOCR3.1版本,以突破性的多语言组合识别(MultilingualCompositionPerception,MCP)技术为核心,彻底重构复杂文档处理边界。此次升级标志着OCR领域首次实现对同一文档内任意混合语言文本的精准识别,为全球化企业、跨境业务及多元文化场

导航网站的崛起:从信息过载到精准触达随着全球AI工具数量爆发式增长(2025年已超数万款),用户面临前所未有的选择困境。传统搜索引擎的“关键词-链接”模式难以应对工具筛选的场景需求,垂直化、场景化的AI导航网站应运而生。这类平台通过聚合、评测、分类与推荐四重机制,将分散的工具资源整合为结构化入口。例

当微信公众号文章中出现一个人的名字,它会自动变成蓝色链接,点击即可查看AI生成的“个人简历”——这一微信新功能让不少用户感到被“扒光”在互联网上。近日,微信新上线的“AI搜索”功能陷入隐私泄露争议漩涡。多位网友在社交平台反映,当微信公众号推文中出现本人姓名时,名字会自动变为蓝色超链接,点击即可浏览由

“你自己还搞技术啊?”这句话,我最近用AI做网站的时候,被好几个人说过。言下之意:你是老板,不该干这个。这半年,我一直在用AI做网站,很多人在我评论里、群里、视频都说过,大意是你不开公司,天天琢磨用AI做网站干嘛?网站都是夕阳行业了。本来还没当回事,结果评论区说的人多了,我自己都恍惚了?我做网站20

昇腾,打响了一场Agent前夜的“硬软合围战”

5月13日,阿里巴巴集团发布2026财年Q4及全年财报。财报表示,阿里全栈AI技术投入已正式跨越初期培育阶段,进入正向的规模商业化回报周期。在财年第四季度,阿里AI在模型、云基础设施和应用各层实现加速突破。在AItoB方向,阿里旗下企业级Agent平台“悟空”已于近期逐步规模化放量。悟空是阿里巴巴旗

近日,负债28万元的张先生被短视频广告吸引,支付39.9元咨询费后,对方承诺减免5万元利息,却在收取14350元服务费后失联。新浪黑猫投诉平台显示,涉及“律所”与“债务协商”的投诉已超1500件。面对债务压力,许多持卡人急需知晓平安信用卡逾期怎么处理,却不慎跌入黑灰产陷阱。虚假承诺借律所外壳行骗,黑

“养龙虾”到底要花多少钱?这个问题可能是大家最关心的。我们把成本拆成三部分:服务器租用费+大模型API调用费+杂项开销。第一部分:服务器租用费。最省钱的方案当然是本地旧电脑自托管——零新增成本,电费忽略不计。但如前所述,你需要接受“不是7×24小时在线”的局限性。如果选择云服务器,成本差异就很大了。

不少朋友第一次接触OpenClaw时,都会有一个相同的困惑:这玩意儿到底该装在哪里?OpenClaw(社区戏称“养龙虾”,因Logo为龙虾钳)不是普通的聊天机器人,而是一款本地优先、可自主执行、支持多Agent分工协作的AI执行网关。说白了,它让大模型从“只会说话”变成“会动手做事”——帮你管理文件

01别相信“一键养虾,躺平赚钱”的鬼话打开社交媒体,你可能会看到这样的标题:“养只龙虾自动炒股,零代码养出数字巴菲特!”信了,你就输了。真实情况是:一个做跨境电商的小哥花了200元租服务器、订阅API,指望龙虾帮他炒股暴富。结果龙虾开始几天还像模像样,后来直接摆烂,生成个干瘪的大纲就敷衍了事。AI是

一张证书引发的讨论4月7日,北京嫣然天使儿童医院给陈光标发了一张感谢证书,感谢他捐赠1000万元。这事说起来挺曲折的。此前陈光标高调说要赠给张雪一台价值1300万元的劳斯莱斯,张雪回应“收了,八折卖掉捐给嫣然”,一番拉扯之后,陈光标把车变现,1000万元直接打到了嫣然医院账上。医院发证书感谢,本来是

2026年4月7日,国家安全部就AI核心术语“词元”(Token)发布安全警示,强调在日均调用量突破140万亿规模的市场背景下,需高度警惕由此引发的数据泄露与金融诈骗风险。据统计,截至今年3月,我国日均词元调用量已超过140万亿,较2024年初增长1000多倍。词元作为大模型处理信息的最小单元,兼具

如今出门,如果你还没用过AI智能助手,可能真有点跟不上节奏了。无论是写作文、查资料,还是规划出行路线,越来越多的人已经习惯随手打开AI问一句。这股热潮背后,中国AI大模型用实打实的数据交出了一份亮眼的成绩单。根据全球知名AI模型聚合平台OpenRouter的最新数据,在3月30日至4月5日这一周,中